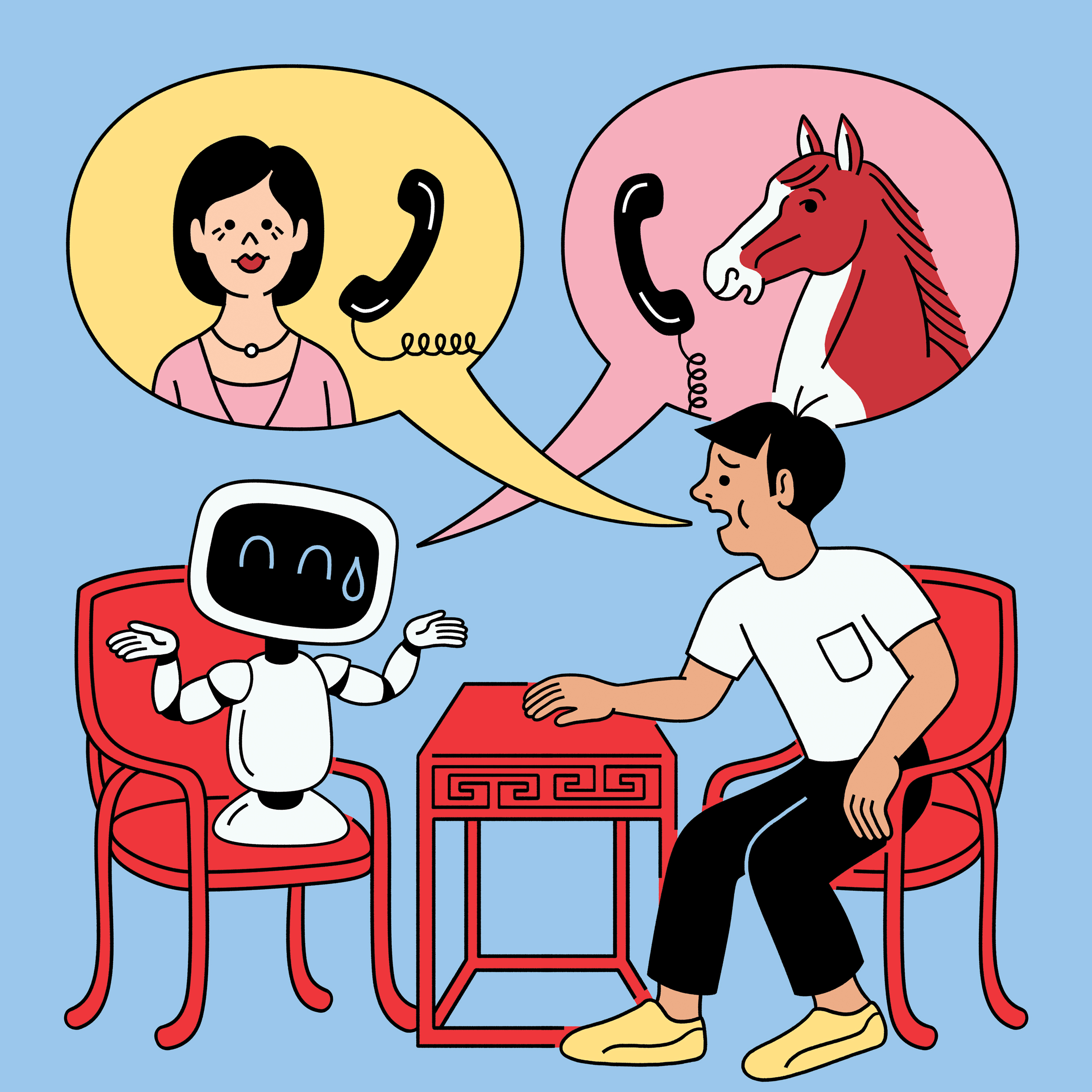

El gran reto de los ordenadores que hablan: aprender chino

ROBÓTICA.

Los desafiantes caracteres de texto del mandarín provocan que la gente tienda a comunicarse con mensajes de voz. Pero a las aplicaciones controladas oralmente también les está costando mucho aprender un idioma especialmente marcado por el contexto y las emociones.

oralmente también les está costando mucho aprender un idioma especialmente marcado por el contexto y las emociones.

Los investigadores a menudo denominan a 2017 como el año del ordenador de conversación en China. El gigante del comercio electrónico Alibaba y el gigante de las búsquedas Baidu han aprovechado algunos recientes avances en reconocimiento de voz y procesamiento de lenguaje natural para desarrollar tecnologías para resolver la comunicación oral. Ahora, productos controlados por la voz derivados de las tecnologías de Baidu y Alibaba están llegando al mercado chino.

El Tmall Genie, que incorpora el asistente de voz de Alibaba, AliGenie, es similar al Amazon Echo. Puede realizar pedidos en línea, consultar el tiempo, reproducir música y controlar otros dispositivos inteligentes del hogar a través de comandos de voz.

La plataforma de conversación DuerOS de Baidu ha sido integrada como prestación en productos como un robot doméstico, un decodificador de televisión y un teléfono inteligente HTC. Tiene funciones similares a AliGenie y otros asistentes de voz, así como una rudimentaria capacidad de llevar a cabo un chat al azar. La compañía afirma haber recibido un gran número de pedidos para su kit de desarrollo DuerOS. El director general de la unidad de Negocios Duer de Baidu, Kun Jing, prevé que muchas más empresas entrarán en el campo este año, motivadas en parte por el éxito de productos como el Echo en el mercado estadounidense, el cual ha despertado el interés de los inversores tecnológicos chinos.

La firma de investigación IDC predice que para el año 2020, el 51% de la industria de la conducción inteligente y el 68% de la industria de teléfonos móviles y dispositivos portables en China integrarán un sistema de inteligencia artificial (IA) basado en la conversación. Al igual que la pantalla táctil facilitó las interacciones con los móviles, unas interfaces mucho más fáciles y basadas en la voz lograrán una interacción más natural y atraerán más gente al mundo conectado, asegura Jing, quien supervisa el desarrollo de DuerOS.

La computación basada en la voz es una buena opción para China. Hoy en día, escribir chino en un típico teclado QWERTY depende de un sistema llamado "pinyin", basado en la pronunciación de los caracteres. Pero como en mandarín existen cuatro tonos y cada uno tiene un significado diferente, el usuario debe seleccionar cuidadosamente el carácter correcto de un menú desplegable tras escribir la pronunciación. Una sílaba común como "yi" puede corresponder a 60 caracteres chinos de uso frecuente o más. Algunos métodos priorizan el carácter más probable según el contexto, pero no siempre aciertan. Como era de esperar, los usuarios de tecnologías móviles como la popular app de mensajería móvil WeChat tienden a enviarse mensajes de voz en lugar de los típicos mensajes de textos de occidente.

En China, ahora mismo la tecnología de asistente de voz convierte los comandos de voz en texto, y después genera una respuesta basada en el significado del texto. Ese proceso funciona bastante bien para los comandos relacionados con tareas (como comprobar el tiempo o buscar la traducción en inglés de una palabra china específica), pero no sirve para mantener una conversación bidireccional sobre múltiples temas.

Para resolver la computación conversacional habrá superar algunas de las desafiantes complejidades del idioma chino. En chino, por ejemplo, los mismos caracteres dispuestos en orden diferente significan cosas diferentes, e incluso cuando están dispuestos en el mismo orden pueden tener significados diferentes en función de lo que los que haya antes y después. Además, el chino escrito no tiene espacios para separar las palabras. Así que los investigadores chinos de procesamiento del lenguaje natural deben enseñar a sus algoritmos dónde insertar espacios para denotar el significado apropiado de una combinación particular de caracteres. La ausencia de los tiempos verbales chinos (no existen formas distintivas para el pasado, presente o futuro) también dificulta que las máquinas averigüen la línea de tiempo de una secuencia de texto.

Estos investigadores también están abordando otros desafíos: existen numerosos dialectos, y algunos son incomprensibles entre sí, y la misma expresión puede significar cosas diferentes en diferentes contextos.

El profesor adjunto de la Universidad de Tsinghua (China) Zhiyong Wu, especializado en la comprensión del lenguaje natural, señala que para que los ordenadores entiendan de verdad la intención de un hablante humano y se comuniquen apropiadamente, tendrán que recoger pistas sutiles como la entonación y el estrés. También tendrán que entender las emociones, ya que la toma de decisiones de los seres humanos no se basa únicamente en la lógica, señala profesora adjunta de la Universidad Tsinghua Jia Jia, que estudia la computación emotiva social.

Para hacer su sistema más inteligente, este año Baidu introdujo un modo "entrenador" en su plataforma que permite a los desarrolladores de software aportar datos de lenguaje en tiempo real a través de un bot integrado. El robot recibe comentarios de los desarrolladores (como la explicación de una consulta que el sistema no ha entendido), aprende de eso y luego corrige el sistema.

Al menos, los investigadores chinos tienen una gran ventaja: una enorme cantidad de datos con los que trabajar. Las redes neuronales que sustentan la comprensión del lenguaje de los ordenadores requieren grandes cantidades de datos con los que entrenarse. Cuantos más datos tenga una compañía, más inteligentes serán sus redes neuronales, y las empresas como Baidu y Alibaba tendrán el beneficio de sus vastas bases de usuarios. A finales de 2016, Baidu afirmó tener 665 millones de usuarios móviles activos al mes, y a fecha de marzo de este año, Alibaba tenía 507 millones de usuarios móviles mensuales activos.

Pero el científico del Laboratorio de IA de Alibaba Gang Wang cree que los investigadores tendrán que diseñar redes neuronales que no necesiten muchos datos para ser más eficientes en el aprendizaje del lenguaje. En el mundo real, la gente expresa lo mismo de formas distintas, y es imposible enseñar a una máquina todas las expresiones posibles, explica. En su anterior papel como investigador académico, él y sus colegas desarrollaron un método para enseñar a los ordenadores a entender un tema cuando se dispone de muy pocos datos: utilizar datos de temas relacionados. Por ejemplo, el entrenamiento de una red neuronal para entender los textos de medicina deportiva podría basarse en datos deportivos y datos médicos. El enfoque no es tan bueno como el uso de datos orgánicos, señala Wang, pero cuando estos faltan, permite la formación de redes neuronales en un tema.

En última instancia, lo que hará que un asistente de voz tenga éxito en China es su contenido y servicios, asegura el fundador de Ainemo, Chenfeng Song, cuya start-up produce un asistente doméstico robótico activado por voz llamado Little Fish que salió a la venta en junio. Song planea desarrollar programas educativos y de salud e incorporarlos en su asistente. Little Fish utiliza la plataforma conversacional DuerOS. La voz, señala Song, es una forma de entregar contenido a personas que no pueden acceder a internet muy bien a través de ordenadores de sobremesa y teléfonos inteligentes, especialmente los ancianos y los niños pequeños.

Por Yiting Sun | traducido por Teresa Woods.

Sitio Fuente: MIT